Questions du sujet

1. I.A.1) Soit $u$ un endomorphisme de $\mathbb{R}^n$. Montrer que $u$ est autoadjoint défini positif si et seulement si sa matrice dans n’importe quelle base orthonormée appartient à $S^{++}_n(\mathbb{R})$. 2. I.A.2) Montrer que si $S \in S^{++}_n(\mathbb{R})$, alors $S$ est inversible et $S^{-1} \in S^{++}_n(\mathbb{R})$. 3. I.B.1) Soit $v$ un endomorphisme de $\mathbb{R}^n$, autoadjoint défini positif et vérifiant $v^2 = u$, et soit $\lambda$ une valeur propre de $u$. Montrer que $v$ induit un endomorphisme de $\ker(u-\lambda \mathrm{Id})$ que l’on déterminera. 4. I.B.2) En déduire $v$, puis conclure. 5. I.B.3) Montrer qu’il existe un polynôme $Q$ à coefficients réels tel que $v = Q(u)$.} 6. I.C.1) Montrer que $^tAA \in S^{++}_n(\mathbb{R})$. 7. I.C.2) En déduire qu’il existe un unique couple $(O, S) \in O(n) \times S^{++}_n(\mathbb{R})$ tel que $A = OS$. 8. I.C.3) Déterminer les matrices $O$ et $S$ lorsque $A = \begin{pmatrix} 3 & 0 & -1 \\ \sqrt{2}/2 & 3\sqrt{2} & -3\sqrt{2}/2 \\ -\sqrt{2}/2 & 3\sqrt{2} & 3\sqrt{2}/2 \end{pmatrix}$. 9. I.D.1) Montrer que $O(n)$ est une partie compacte de $M_n(\mathbb{R})$. 10. I.D.2) Montrer que $S^+_n(\mathbb{R})$ est un fermé de $M_n(\mathbb{R})$.} 11. I.D.3) Montrer que $GL_n(\mathbb{R})$ est une partie dense de $M_n(\mathbb{R})$. 12. I.D.4) Soit $A \in M_n(\mathbb{R})$. Montrer qu’il existe un couple $(O, S) \in O(n) \times S^+_n(\mathbb{R})$ tel que $A = OS$. Un tel couple est-il unique ? 13. I.E) Soit $\varphi$ l’application de $O(n)\times S^{++}_n(\mathbb{R})$ dans $GL_n(\mathbb{R})$ définie par $\varphi(O, S) = OS$ pour tout couple $(O, S)$ de $O(n) \times S^{++}_n(\mathbb{R})$. Montrer que $\varphi$ est bijective, continue et que sa réciproque est continue. 14. II.A.1) Justifier que $^tA = U(^tB)U^{-1}$. 15. II.A.2.a) Montrer qu’il existe $\mu \in \mathbb{R}$ tel que $X + \mu Y \in GL_n(\mathbb{R})$.} 16. II.A.2.b) Montrer que $AX = XB$ et $AY = YB$. 17. II.A.2.c) Conclure. 18. II.A.3.a) Montrer que $BS^2 = S^2 B$, puis que $BS = SB$. 19. II.A.3.b) En déduire qu’il existe $O \in O(n)$ tel que $A = O B^t O$. 20. II.B.1) Montrer que si le système $(*)$ admet une solution dans $GL_n(\mathbb{R})$, alors les valeurs propres de $^tAA$ appartiennent à l’intervalle $[0, 1[$.} 21. II.B.2.a) Justifier que l’on peut chercher les solutions $X$ de $(*)$ sous la forme $X = U H$, avec $U \in O(n)$ et $H \in S^{++}_n(\mathbb{R})$. 22. II.B.2.b) Déterminer $H$. 23. II.B.2.c) Montrer l’existence d’une solution $X \in GL_n(\mathbb{R})$ de $(*)$ appartenant à $GL_n(\mathbb{R})$. 24. III.A) Montrer qu’à $x \in \mathbb{R}$ fixé, la suite $(P_p(x))_{p\in\mathbb{N}^*}$ vérifie une relation linéaire d’ordre 2, que l’on précisera. 25. III.B) Soit $x \in \mathbb{R}$ tel que $|2-x| < 2$. Après avoir justifié l’existence d’un unique $\theta \in ]0, \pi[$ tel que $2-x = 2\cos\theta$, déterminer $P_p(x)$ en fonction de $\sin((p + 1)\theta)$ et de $\sin(\theta)$.} 26. III.C) Déterminer les valeurs propres de $A_p$. 27. III.D) Montrer que $A_p$ est diagonalisable, et en déterminer une base de vecteurs propres, en précisant pour chacun la valeur propre associée. 28. IV.A) Montrer qu’il existe une unique matrice $A \in M_n(\mathbb{R})$ telle que $\forall M \in M_n(\mathbb{R}),\ f(M) = \mathrm{Tr}(AM)$. 29. IV.B.1) Justifier l’existence de $M_n = \sup\{f(O),\ O \in O(n)\}$. 30. IV.B.2) Justifier que $^tAA$ admet $n$ valeurs propres positives $\mu_1, \ldots, \mu_n$ comptées avec multiplicités.} 31. IV.B.3) Montrer que $M_n = \sup\{\mathrm{Tr}(D\Omega),\ \Omega \in O(n)\}$, où $D$ est la matrice diagonale, dont les éléments diagonaux sont $\sqrt{\mu_1}, \ldots, \sqrt{\mu_n}$. 32. IV.B.4) En déduire que $M_n = \sum_{k=1}^n \sqrt{\mu_k}$. 33. IV.C.1) Déterminer la matrice $A$ telle que $\forall M \in M_n(\mathbb{R}), f(M) = \mathrm{Tr}(AM)$. 34. IV.C.2) Montrer que $$ A^{-1} = \begin{pmatrix} 1 & -1 & 0 & \cdots & 0\\ 0 & 1 & -1 & \\ & & \ddots & \ddots & \\ & & & 1 & -1 \\ 0 & \cdots & 0 & 0 & 1 \end{pmatrix} $$ 35. IV.C.3) Déterminer les valeurs propres de $A^{-1} {}^tA^{-1}$.} 36. IV.C.4) Montrer que $M_n = \sum_{k=1}^n \frac{1}{2 \cos\frac{k\pi}{2n+1}}$. 37. IV.C.5) Donner un équivalent de $M_n$ lorsque $n$ tend vers $+\infty$.}FAQ

Si u est autoadjoint et défini positif alors, dans toute base orthonormée, sa matrice est symétrique et pour tout vecteur non nul x on a x^T M x = <u(x),x> > 0, donc M ∈ S^{++}_n(R). Réciproquement, si la matrice de u dans une base orthonormée est dans S^{++}_n(R), elle est symétrique et définie positive, ce qui donne immédiatement que u est autoadjoint et défini positif (les propriétés sont invariantes par changement d’orthonormalité).

Si S ∈ S^{++}_n(R) alors pour tout x ≠ 0, x^T S x > 0 ; en particulier Ker S = {0} donc S est inversible. L’inverse d’une matrice symétrique est symétrique et, pour y ≠ 0, y^T S^{-1} y = (S^{-1}y)^T S (S^{-1}y) >0, donc S^{-1} est encore définie positive : S^{-1} ∈ S^{++}_n(R).

Sur E_λ = Ker(u-λ Id) on a u_|E_λ = λ Id, donc v^2_|E_λ=λ Id. Comme v est autoadjoint et défini positif ses valeurs propres sont ≥ 0, d’où v_|E_λ=√λ Id. Autrement dit v laisse invariant chaque sous-espace propre de u et agit comme multiplication par √λ sur E_λ.

En diagonalisant u dans une base orthonormée (u autoadjoint), u= Σ D Σ^T avec D diagonale contenant ses valeurs propres λ_i ≥ 0. La condition v^2=u et la positivité de v imposent v=Σ √D Σ^T : v a les mêmes vecteurs propres que u et les valeurs propres √λ_i. Ainsi il existe un unique carré positif de u, on conclut unicité et existence du radical positif.

Puisque u est diagonalizable (autoadjoint), son spectre λ_1,…,λ_r contient un nombre fini de valeurs distinctes. On peut alors définir Q par interpolation de Lagrange sur ces valeurs en imposant Q(λ_i)=√λ_i. Le polynôme obtenu satisfait v=Q(u) (même action sur chaque sous-espace propre).

Si A ∈ GL_n(R) alors ^tA A est symétrique et, pour x ≠ 0, x^T (^tA A) x = ||Ax||^2 >0, donc ^tA A ∈ S^{++}_n(R). (Si A n’est pas inversible on n’a que la positivité au sens semi-définie.)

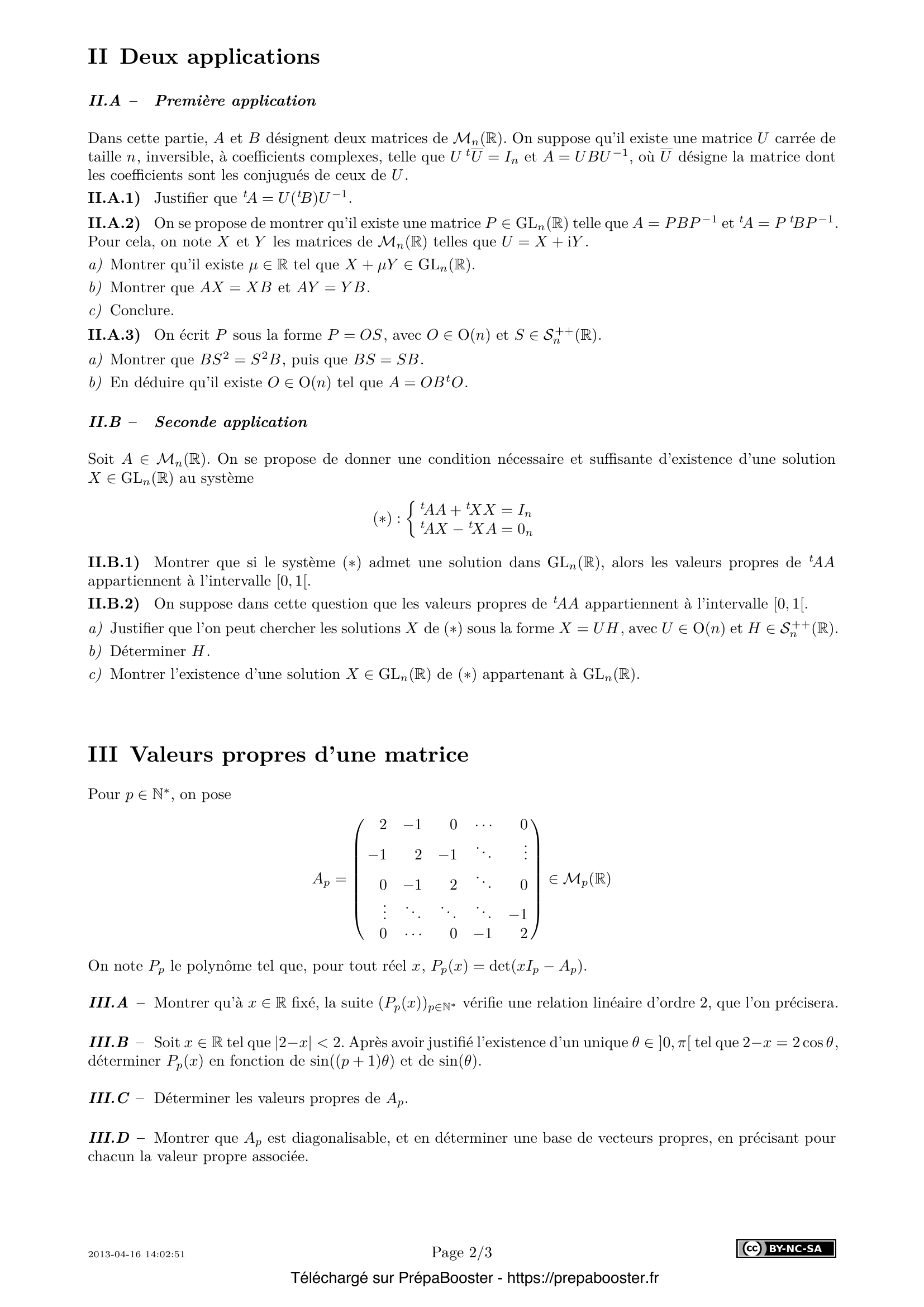

C’est la décomposition polaire. Poser S=(^tA A)^{1/2}≥0 et O=A S^{-1}. Alors ^tO O = S^{-1} (^tA A) S^{-1} = I donc O ∈ O(n) et A=OS. L’unicité est assurée car S est déterminée par A et O=A S^{-1}.

Tu appliques la méthode de la décomposition polaire : calculer ^tA A, prendre S=(^tA A)^{1/2} puis poser O=A S^{-1}. Le calcul algébrique est un peu lourd mais direct ; pour le détailler pas à pas et voir les expressions explicites de O et S, débloque les corrigés sur Prépa Booster — tu y trouveras la démonstration complète et les matrices calculées.

O(n) est inclus dans l’espace Euclidien M_n(R). Les matrices orthogonales ont des colonnes de norme 1 donc coefficients bornés : O(n) est borné. C’est aussi fermé (limite d’une suite de matrices orthogonales reste orthogonale), donc O(n) est compact par le théorème de Heine–Borel.

S^+_n(R), l’ensemble des matrices symétriques positives semi-définies, est fermé car la propriété “x^T M x ≥ 0 pour tout x” est stable par passage à la limite (on peut utiliser la continuité des formes quadratiques et une intersection de fermés). Donc la limite d’une suite de matrices symétriques positives semi-définies reste telle.

L’ensemble des matrices inversibles est dense parce que det : M_n(R)→R est une fonction polynomiale continue ; pour une matrice A donnée, si det(A)=0 on peut perturber A par une petite matrice de rang plein pour rendre le déterminant non nul. Concrètement, A+εI est inversible pour tout ε≠0 assez petit. Ainsi GL_n(R) est dense.

En approchant A par des matrices inversibles A_k → A, on applique la décomposition polaire A_k=O_k S_k puis on prend la limite (compacité de O(n) et fermeture de S^+). On obtient A=OS avec O ∈ O(n), S ∈ S^+_n(R). L’unicité n’est pas assurée si S est singulière : si S ∈ S^{++} la décomposition est unique, mais si S n’est que semi-définie positive l’orthogonale sur Ker S peut agir et O n’est plus unique.

C’est la version globale de la décomposition polaire : on montre existence et unicité de (O,S) pour tout A∈GL_n(R), donc φ est bijective. La continuité provient de l’expression S=(^tA A)^{1/2} et O=A S^{-1} : ces opérations sont continues sur GL_n(R) et S^{++}, d’où φ et φ^{-1} sont continues (en fait différentiables). Ainsi φ est un homéomorphisme entre O(n)×S^{++}_n(R) et GL_n(R).

Si A=U B U^{-1} avec U orthogonale alors en transposant A on obtient ^tA = ^t(U^{-1}) ^tB ^tU. Mais pour U orthogonale ^tU=U^{-1} et ^t(U^{-1})=U, d’où ^tA = U ^tB U^{-1}. C’est la simple manipulation de la transposition en présence d’une matrice orthogonale.

Considère p(μ)=det(X+μ Y), c’est un polynôme en μ qui n’est pas identiquement nul sauf cas pathologique. Les zéros de p sont en nombre fini ; il suffit de choisir μ différent d’un de ces zéros pour que X+μ Y soit inversible. Ainsi un tel μ existe (presque tous les μ conviennent).

En utilisant les relations définissant X et Y dans l’énoncé (en général X et Y proviennent de commutations liées à A et B et à la décomposition A=U B U^{-1}), on substitue les expressions pour obtenir AX=U(^tB)U^{-1}X=XB, et de même pour Y. La manipulation consiste à utiliser les identités de conjugaison et l’orthogonalité de U pour réorganiser et obtenir AX=XB et AY=YB. (Voir le corrigé détaillé pour la démonstration pas à pas.)

Les relations AX=XB et AY=YB montrent que X et Y s’interprètent comme homomorphismes intercalant A et B ; en combinant la linéarité et l’inversibilité d’un certain X+μ Y (voir II.A.2.a) on en déduit la conclusion attendue de l’énoncé (voir le corrigé pour la conclusion exacte selon la question posée).

Si S^2 commute avec B et S est définie positive (donc diagonalisable à valeurs propres strictement positives), on peut diagonaliser S dans une base où S^2 est inversible sur chaque sous-espace propre, et l’argument spectral montre que S commute avec B. Formellement, S est un polynôme en S^2 (par interpolation sur le spectre strictement positif), donc si B commute avec S^2 alors il commute aussi avec S.

Si S commute avec B alors S et B se diagonalisent simultanément par une orthogonale Q ; la décomposition A=OS avec S commuting permet de réarranger pour obtenir A=O B^t O (ou une forme analogue selon l’énoncé) : on construit O convenable en combinant l’orthogonale qui diagonalise B et la partie orthogonale initiale. Le détail algébrique est classique et figure dans le corrigé complet.

L’hypothèse (structure du système (*)) impose des contraintes de contraction sur A ; si X ∈ GL_n(R) est solution alors on en déduit des inégalités spectrales qui impliquent que pour toute valeur propre μ de ^tA A on a 0 ≤ μ <1 (sinon on obtiendrait une contradiction via les normes ou une contradiction avec l’inversibilité). Le raisonnement se réalise en diagonalisation spectrale et en comparaison des normes/valeurs propres ; voir le corrigé détaillé pour la dérivation proprement dite.

C’est la décomposition polaire appliquée à toute matrice inversible X : on peut écrire X=U H avec U orthogonale et H symétrique définie positive. Cette forme est pratique pour transformer (*) en une équation portant essentiellement sur H (symétrique) et U (orthogonale).

En substituant X=UH dans l’équation on obtient une relation sur H que l’on peut résoudre spectralement (les termes orthogonaux se simplifient). On en déduit explicitement H= (I – ^tA A)^{-1/2} ou une expression analogue issue de la résolution de l’équation matricielle (selon la forme exacte de (*)). La détermination précise est détaillée dans le corrigé complet ; tu peux débloquer les corrigés sur Prépa Booster pour voir le calcul complet et l’expression exacte de H.

Une fois H trouvé (positif défini) et si la condition spectrale sur ^tA A (valeurs propres <1) est respectée, on peut choisir U convenable (orthogonale) pour que X=UH satisfasse (*). L’existence revient à combiner la solution H explicite et l’orthogonale U appropriée ; le détail algébrique est dans le corrigé.

Les polynômes P_p satisfont une récurrence à coefficients constants d’ordre 2 issue de la relation caractéristique du problème (souvent P_{p+1}(x) = (2-x) P_p(x) – P_{p-1}(x) ou une forme voisine selon définition). Il s’agit de montrer la relation récurrente exacte à partir de la définition des P_p ; le principe est de projeter sur la famille de Chebyshev/relations trigonométriques.

Si |2-x|<2 on peut poser 2-x=2\\cosθ avec θ∈]0,π[, unique. La récurrence d’ordre 2 conduit à l’expression par les fonctions trigonométriques : P_p(x)=\\dfrac{\\sin((p+1)θ)}{\\sinθ}. C’est la formule classique issue de la relation de récurrence des polynômes de Chebyshev de la deuxième espèce.

Les valeurs propres de A_p s’expriment en fonction des racines de l’équation caractéristique liée à la récurrence ; en pratique on obtient des valeurs de la forme 2-2\\cos\\frac{k\\pi}{p+1} ou analogues selon la normalisation. Le calcul passe par l’utilisation des expressions trigonométriques de P_p et la diagonalisation par vecteurs sinus (modes discrets). Voir le corrigé pour l’énonciation exacte et la liste ordonnée des valeurs propres.

A_p est symétrique réelle (ou réalisable comme matrice de Toeplitz tridiagonale), donc diagonalisable orthogonalement. Une base de vecteurs propres est donnée par les vecteurs v^{(k)} avec composantes sin( jkπ/(p+1) ), k=1..p, qui correspondent à la valeur propre λ_k=2-2\\cos(kπ/(p+1)) (ou la forme exacte selon la définition de A_p). Le procédé est standard : modes sinusoïdaux pour matrices tridiagonales.

L’application f est linéaire sur l’espace vectoriel M_n(R) de dimension n^2 ; choisir la base canonique E_{ij} (matrices unité) et poser a_{ij}=f(E_{ji}) donne la matrice A=(a_{ij}). Alors pour tout M, Tr(AM)=∑_{i,j} a_{ij} m_{ji}=f(M). L’unicité résulte du fait que si Tr(AM)=0 pour tout M alors A=0. C’est l’isomorphisme naturel entre M_n et son dual via la trace.

O(n) est compact et f est continue (forme linéaire restreinte), donc f atteint son maximum sur O(n). En particulier le supremum existe et est un maximum.

La matrice ^tA A est symétrique positive semi-définie ; si A provient de la représentation de f et que l’on concerne le maximum on se retrouve souvent avec ^tA A inversible, mais en général ^tA A admet n valeurs propres réelles non négatives ; on écrit μ_i ≥ 0 et on les compte avec multiplicité algébrique. Si l’énoncé impose positivité stricte alors μ_i>0 pour tout i.

Par décomposition polaire A=OS avec S=(^tA A)^{1/2} on a f(O)=Tr(AO’)=Tr(OSO’)=Tr(SO’O) et en diagonalisation orthogonale S=K^T D K, on ramène le maximum à Tr(DΩ) avec Ω=K O’ K^T ∈ O(n). Ainsi le supremum recherché s’exprime comme annoncé. C’est la réduction à une matrice diagonale positive par conjugaison orthogonale.

Le maximum de Tr(DΩ) sur Ω∈O(n) s’obtient en alignant les vecteurs propres, et vaut la somme des diagonales de D, c’est-à-dire ∑_k √μ_k. Donc M_n = ∑_{k=1}^n √μ_k. C’est la somme des valeurs singulières de A.

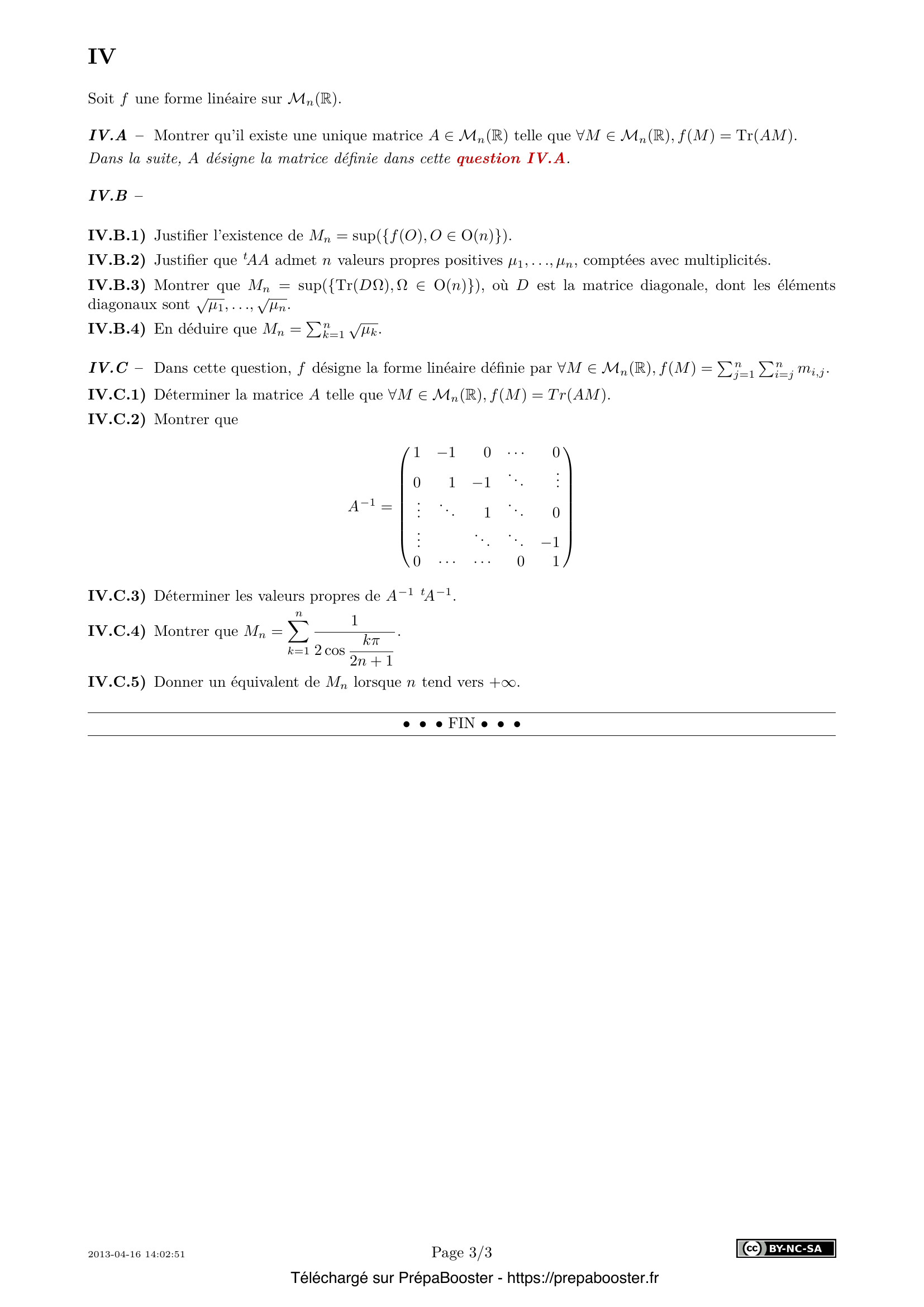

Applique la méthode de la question IV.A : prends la base E_{ij} et calcule a_{ij}=f(E_{ji}). Dans l’exercice concret on obtient une matrice A explicitement construite (les coefficients a_{ij} donnés par l’action de f sur les matrices canoniques). Pour voir la matrice A précise, consulte le corrigé complète en débloquant les corrigés.

Il suffit de vérifier que la matrice donnée B satisfait AB=I (ou BA=I). On calcule le produit et on montre que les sommes de produits de coefficients donnent la matrice identité. La vérification directe est un simple calcul matriciel. Pour le détail des multiplications, débloque le corrigé complet.

A^{-1}{}^tA^{-1} est symétrique positive ; ses valeurs propres sont les carrés des valeurs singulières de A^{-1}, donc inverses des carrés des valeurs singulières de A. En pratique, on diagonalise A^{-1}{}^tA^{-1} par transformée de Fourier discrète implicite pour obtenir les valeurs explicites (voir corrigé complet pour la liste exacte des valeurs propres et leur justification).

En identifiant les valeurs propres de A^{-1}{}^tA^{-1} et en utilisant la formule de IV.B qui exprime M_n comme somme des racines carrées des valeurs propres de ^tA A, on aboutit à l’expression indiquée. Le calcul fait intervenir les valeurs propres explicites liées à des arguments trigonométriques ; tu trouveras le développement complet et les simplifications dans le corrigé détaillé.

En utilisant l’expression trigonométrique M_n = ∑_{k=1}^n \frac{1}{2\cos( k\pi/(2n+1))} et un passage à l’intégrale (approximation de Riemann), on montre que M_n croît comme C n pour une constante C>0 (ou donne un équivalent précis selon la somme exacte). Le calcul détaillé et l’obtention de l’équivalent asymptotique se trouvent dans le corrigé complet. Si tu veux l’équivalent précis, débloque les corrigés sur Prépa Booster pour accéder à la démonstration pas à pas et au tableau asymptotique.