Questions du sujet

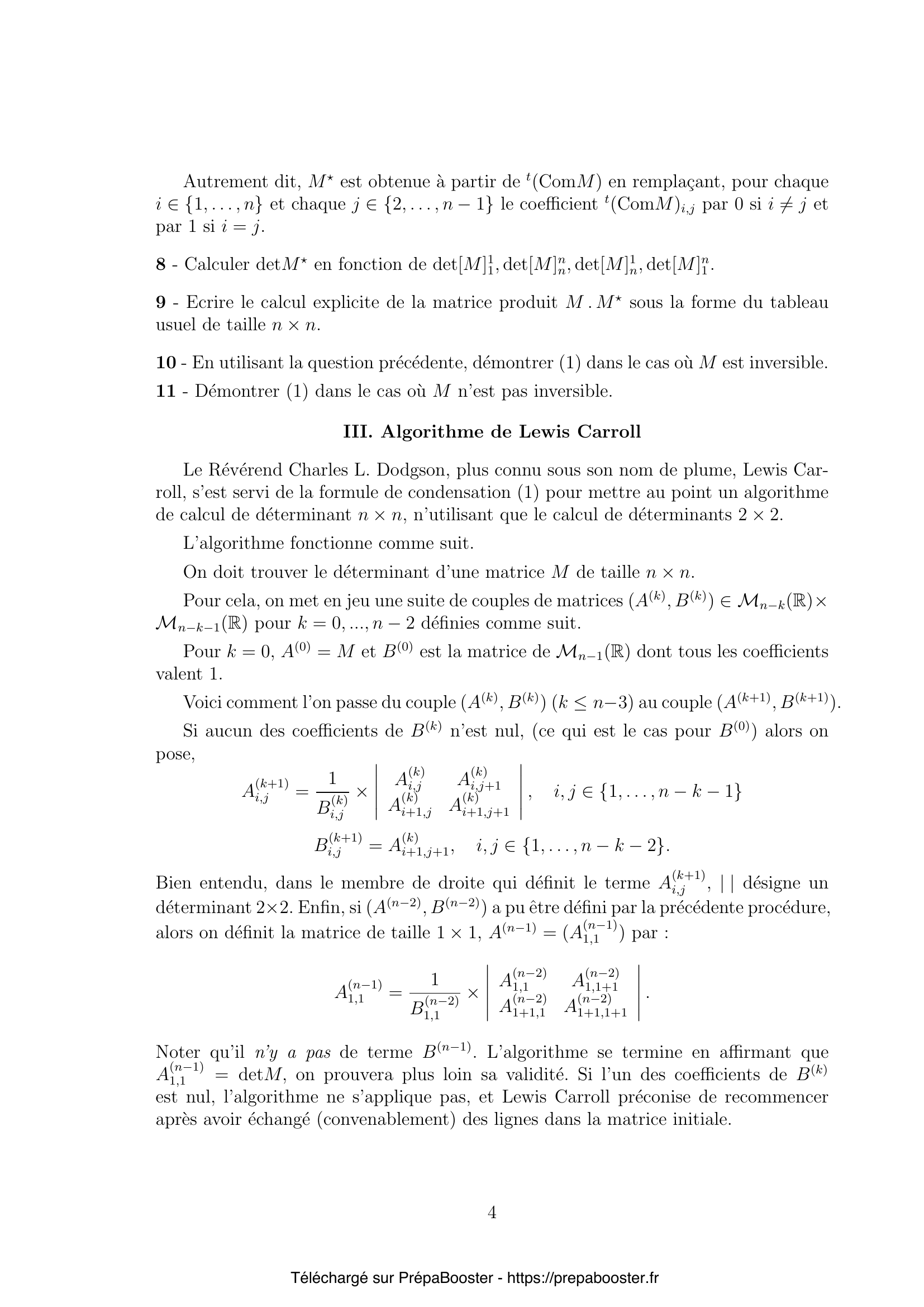

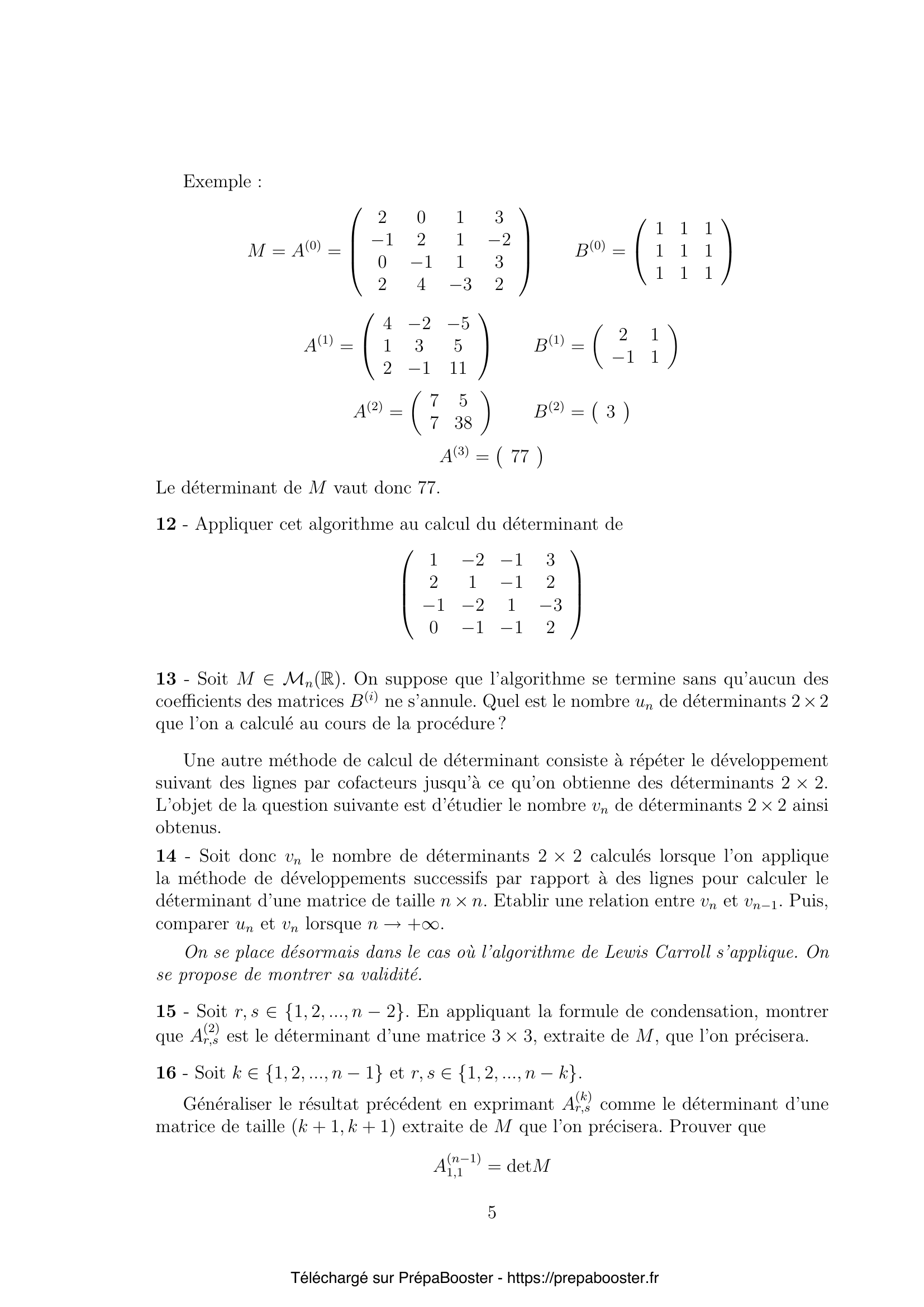

1. Soit $n \in \mathbb{N}^{\ast}$ un entier non nul. Montrer que l’application $N$ de $M_n(\mathbb{R})$ dans $\mathbb{R}$ définie par $$ \forall M \in M_n(\mathbb{R}),\ N(M) = \sup_{i, j \in \{1, \ldots, n\}} |M_{i,j}|, $$ est une norme sur $M_n(\mathbb{R})$.} 2. Dans le cas où $M \in M_n(\mathbb{R})$ n’est pas inversible, on rappelle qu’il existe deux matrices inversibles $P$ et $Q$ (de tailles $n \times n$) telles que $M = P.J.Q$ où $$ J = \begin{pmatrix} 1 & & & & 0 \\ & \ddots & & & \\ & & 1 & & (0) \\ 0 & (0) & & 0 & \\ & & & & 0 \end{pmatrix} $$ $J$ étant une matrice diagonale dont les $r$ premiers éléments diagonaux valent $1$ et dont les $n-r$ derniers éléments diagonaux valent $0$. Si $J = 0$, on convient que $r = 0$.\\ Rappeler l’interprétation de $r$.} 3. On conserve les notations de la question précédente. Montrer qu’il existe une suite de matrices inversibles $(J_k)_{k \in \mathbb{N}}$ de $M_n(\mathbb{R})$ telle que $M = \lim_{k \rightarrow +\infty} P.J_k.Q$ au sens de la distance associée à la norme $N$.} 4. Montrer que le déterminant définit une fonction continue de $M_n(\mathbb{R})$, muni de la distance associée à la norme $N$, dans $\mathbb{R}$ (on pourra écrire le déterminant comme une somme de fonctions toutes en forme de produits).} 5. Soit $i \in \{1, 2, …, n\}$. Calculer $$ M_{i,1} \det[M]^1_i – M_{i,2} \det[M]^2_i + \ldots + (-1)^{n-1} M_{i,n} \det[M]^n_i $$ en fonction de $\det M$ et de $i$.} 6. Montrer que $$ M_{j,1} \det[M]^1_i – M_{j,2} \det[M]^2_i + \ldots + (-1)^{n-1} M_{j,n} \det[M]^n_i = 0 $$ pour $i, j \in \{1, 2, …, n\}$, vérifiant $i \ne j$ (on interprétera le membre de gauche comme le développement par rapport à une ligne du déterminant d’une certaine matrice).} 7. Déduire des deux questions précédentes le fait que $M \cdot {}^{t}(\mathrm{Com} M) = x I_n$ où $x$ est un nombre réel que l’on précisera.} 8. On introduit la matrice de $M_n(\mathbb{R})$ suivante : $$ M^{\ast} = \begin{pmatrix} \det[M]^1_1 & 0 & 0 & \cdots & 0 & (-1)^{n+1} \det[M]^1_n \\ -\det[M]^2_1 & 1 & 0 & \cdots & 0 & (-1)^{n+2} \det[M]^2_n \\ \det[M]^3_1 & 0 & 1 & \cdots & 0 & (-1)^{n+3} \det[M]^3_n \\ \vdots & & & \ddots & & \vdots \\ (-1)^n \det[M]^{n-1}_1 & 0 & 0 & \cdots & 1 & -\det[M]^{n-1}_n \\ (-1)^{n+1} \det[M]^n_1 & 0 & 0 & \cdots & 0 & \det[M]^n_n \end{pmatrix} $$ Calculer $\det M^{\ast}$ en fonction de $\det[M]^1_1, \det[M]^n_n, \det[M]^1_n, \det[M]^n_1$.} 9. Écrire le calcul explicite de la matrice produit $M \cdot M^\ast$ sous la forme du tableau usuel de taille $n \times n$.} 10. En utilisant la question précédente, démontrer (1) dans le cas où $M$ est inversible.} 11. Démontrer (1) dans le cas où $M$ n’est pas inversible.} 12. Appliquer cet algorithme au calcul du déterminant de $$ \begin{pmatrix} 1 & -2 & -1 & 3 \\ 2 & 1 & -1 & 2 \\ -1 & -2 & 1 & -3 \\ 0 & -1 & -1 & 2 \end{pmatrix} $$ 13. Soit $M \in M_n(\mathbb{R})$. On suppose que l’algorithme se termine sans qu’aucun des coefficients des matrices $B^{(i)}$ ne s’annule. Quel est le nombre $u_n$ de déterminants $2 \times 2$ que l’on a calculé au cours de la procédure ?} 14. Soit donc $v_n$ le nombre de déterminants $2 \times 2$ calculés lorsque l’on applique la méthode de développements successifs par rapport à des lignes pour calculer le déterminant d’une matrice de taille $n \times n$. Établir une relation entre $v_n$ et $v_{n-1}$. Puis, comparer $u_n$ et $v_n$ lorsque $n \to +\infty$.} 15. Soit $r, s \in \{1, 2, …, n-2\}$. En appliquant la formule de condensation, montrer que $A^{(2)}_{r,s}$ est le déterminant d’une matrice $3 \times 3$, extraite de $M$, que l’on précisera.} 16. Soit $k \in \{1, 2, …, n-1\}$ et $r, s \in \{1, 2, …, n-k\}$. Généraliser le résultat précédent en exprimant $A^{(k)}_{r,s}$ comme le déterminant d’une matrice de taille $(k+1, k+1)$ extraite de $M$ que l’on précisera. Prouver que $A^{(n-1)}_{1,1} = \det M$} 17. Soit $\lambda \in \mathbb{R}$. On introduit la notion de $\lambda$-déterminant d’une matrice $M \in M_n(\mathbb{R})$ convenable, noté $\det_\lambda M$, de la manière suivante.\\ Soit $(a) \in M_1(\mathbb{R})$, $\det_\lambda(a) = a$.\\ Soit $\begin{pmatrix}a & b\\c & d\end{pmatrix} \in M_2(\mathbb{R})$, $\det_\lambda \begin{pmatrix}a & b\\c & d\end{pmatrix} = ad + \lambda bc$.\\ On impose de plus, pour toute matrice $M$ de $M_n(\mathbb{R})$, la formule de condensation suivante : $$ \det_\lambda M\det_\lambda[M]^{1,n}_{1,n} = \det_\lambda[M]^{1}_{1}\det_\lambda[M]^{n}_{n} + \lambda \det_\lambda[M]^{1}_{n}\det_\lambda[M]^{n}_{1} \quad (2) $$ Cette condition $(2)$ permet donc de définir, par récurrence, le $\lambda$-déterminant pour une matrice $M$ de taille $n \times n$, à la condition de ne pas avoir à diviser par $0$ au cours de son calcul. Plus précisément, supposons que cette procédure par récurrence ait permis de définir le membre de droite de $(2)$ ainsi que $\det_\lambda[M]^{1,n}_{1,n}$ et qu’en plus ce dernier soit non nul. Alors on définit $\det_\lambda M$ par $(2)$ puisqu’on peut diviser par $\det_\lambda[M]^{1,n}_{1,n} \neq 0$.\\ Dans la suite, $M$ désigne une matrice de $M_n(\mathbb{R})$ pour laquelle $\det_\lambda M$ est bien défini.\\ Soit $t \in \mathbb{R} \backslash \{0\}$, et $j \in \{1, …, n\}$. On note $M_{t,j}$ la matrice obtenue à partir de $M$ par multiplication de la $j$-ième colonne de $M$ par $t$. Montrer que $\det_\lambda M_{t,j}$ est bien défini et donner sa valeur en fonction de $\det_\lambda M$ et de $t$.} 18. On considère un vecteur $(x_1, x_2, \ldots, x_n)$ de $\mathbb{R}^n$ tel que les réels $x_i$ sont tous non nuls. On introduit la matrice de Vandermonde de taille $n \times n$ : $$ V(x_1, x_2, \ldots, x_n) = (x_i^{j-1})_{1 \leq i, j \leq n}, $$ où $x_i^{j-1}$ est le coefficient situé sur la $i$-ème ligne et la $j$-ème colonne.\\ On suppose que $x_j + \lambda x_i$ est non nul pour tous $i, j \in \{1, \ldots, n\}$ tels que $1 \leq i < j \leq n$. Calculer $\det_\lambda V(x_1, x_2, \ldots, x_n)$ en fonction des $x_j + \lambda x_i$, $(i, j \in \{1, \ldots, n\})$. (On commencera par le cas $n=3$ puis on procédera par récurrence sur $n$).}FAQ

Une norme matricielle permet de mesurer la taille ou la « grandeur » d’une matrice, un peu comme une norme classique pour un vecteur. Elle sert à estimer la distance entre matrices, à étudier la continuité des applications et à contrôler les approximations lors des calculs. Dans le sujet Mines-Ponts PSI 2010, la norme considérée (la norme de sup des coefficients) sert de base pour parler de convergence et de continuité sur l’espace des matrices, ce qui est crucial pour aborder la stabilité de certains algorithmes et la théorie des matrices inversibles.

Le rang d’une matrice, c’est le nombre maximal de vecteurs linéairement indépendants parmi ses colonnes (ou ses lignes). C’est un indicateur de la « richesse » de la matrice et des solutions que peuvent admettre les systèmes linéaires associés. Dans le sujet Mines-Ponts 2010, tu as vu que le rang intervient partout : il décide si une matrice est inversible, il intervient dans la réduction de matrices ou dans l’algorithme de calcul du déterminant. Maîtriser le rang, c’est comprendre toute l’algèbre linéaire en CPGE !

La continuité du déterminant n’est pas qu’un détail technique : elle garantit que de petites perturbations des coefficients de la matrice entraînent de petites variations du déterminant. Pour les concours type Mines-Ponts, c’est indispensable pour justifier des raisonnements par passage à la limite, pour comprendre la stabilité des solutions et pour maîtriser les théorèmes de base de l’algèbre linéaire. Pour creuser ces notions avec corrections détaillées et exercices, pense à débloquer les corrigés sur Prépa Booster !

La comatrice, notée Com(M), est la matrice formée des cofacteurs de M, c’est-à-dire des déterminants des mineurs de M affectés d’un signe. Elle permet le calcul de l’inverse d’une matrice carrée inversible, mais elle intervient aussi dans les développements du déterminant par rapport à une ligne ou une colonne (formule de Laplace). En fait, elle te donne la clé pour manipuler les déterminants comme un chef : que tu calcules ou que tu raisonnes sur les propriétés de M, tu croiseras toujours la comatrice !

Les algorithmes de condensation (type Dodgson) et de Laplace servent à décomposer le calcul d’un déterminant en mineurs, donc en sous-déterminants plus simples. L’objectif, c’est d’optimiser le nombre de calculs, d’éviter les pièges d’erreur de signes ou de réduire la taille du problème. Laplace est universel, mais la condensation peut être surpuissante pour les matrices ayant beaucoup de zéros ou pour certains concours. Bien choisir vient avec la pratique. Tu veux t’entraîner sur des corrigés variés ? Sur Prépa Booster, tu accèdes à des exercices corrigés pas à pas et à un dashboard pour suivre tes progrès !

Le λ-déterminant est une généralisation du déterminant classique, où la formule du 2×2 devient ad + λbc au lieu de ad – bc. En imposant une relation de récurrence reliant les λ-déterminants et ceux des mineurs, tu peux explorer de nouvelles familles de matrices ou de propriétés algébriques. Dans les sujets CPGE, cette notion entraîne souvent des raisonnements par récurrence compliqués, une réflexion sur l’invariance et la manipulation symbolique. C’est typiquement un sujet qui pousse à la réflexion profonde sur la structure des formules algébriques.

La matrice de Vandermonde est partout car c’est un excellent exemple pour explorer la combinatoire des indices, la structure des déterminants et la factorisation. Son déterminant s’exprime comme un produit, et quand on le complique (λ-déterminant), cela permet de tester ta maîtrise de la récurrence, de la manipulation symbolique et de la compréhension profonde des matrices spéciales. Retrouve des corrigés détaillés sur ce type de sujet en débloquant l’accès sur Prépa Booster, pour aller jusqu’au bout de la méthode et ne plus jamais te faire piéger en épreuve !